Google A2UI, ein im Dezember 2025 als Public Preview veröffentlichtes Open‑Source‑Protokoll, verändert die Schnittstelle zwischen Nutzerinnen und Systemen: Es erlaubt KI‑Agenten, strukturierte Beschreibungen von Oberflächen zu erzeugen, die Host‑Apps nativ rendern. Diese Entwicklung stellt die Frage in den Raum, ob traditionelle Benutzeroberflächen künftig von Künstlicher Intelligenz ersetzt werden und welche Folgen das für Softwareentwicklung, Benutzererfahrung und die Zukunft der Arbeit hat.

Dieser Beitrag analysiert drei Aspekte: technische Funktionsweise und Sicherheitsprinzipien von A2UI, konkrete Effekte auf die Gestaltung digitaler Produkte und die wirtschaftlichen sowie organisatorischen Konsequenzen für Unternehmen und Beschäftigte.

Google A2UI als neues Protokoll für agentengesteuerte Benutzeroberflächen

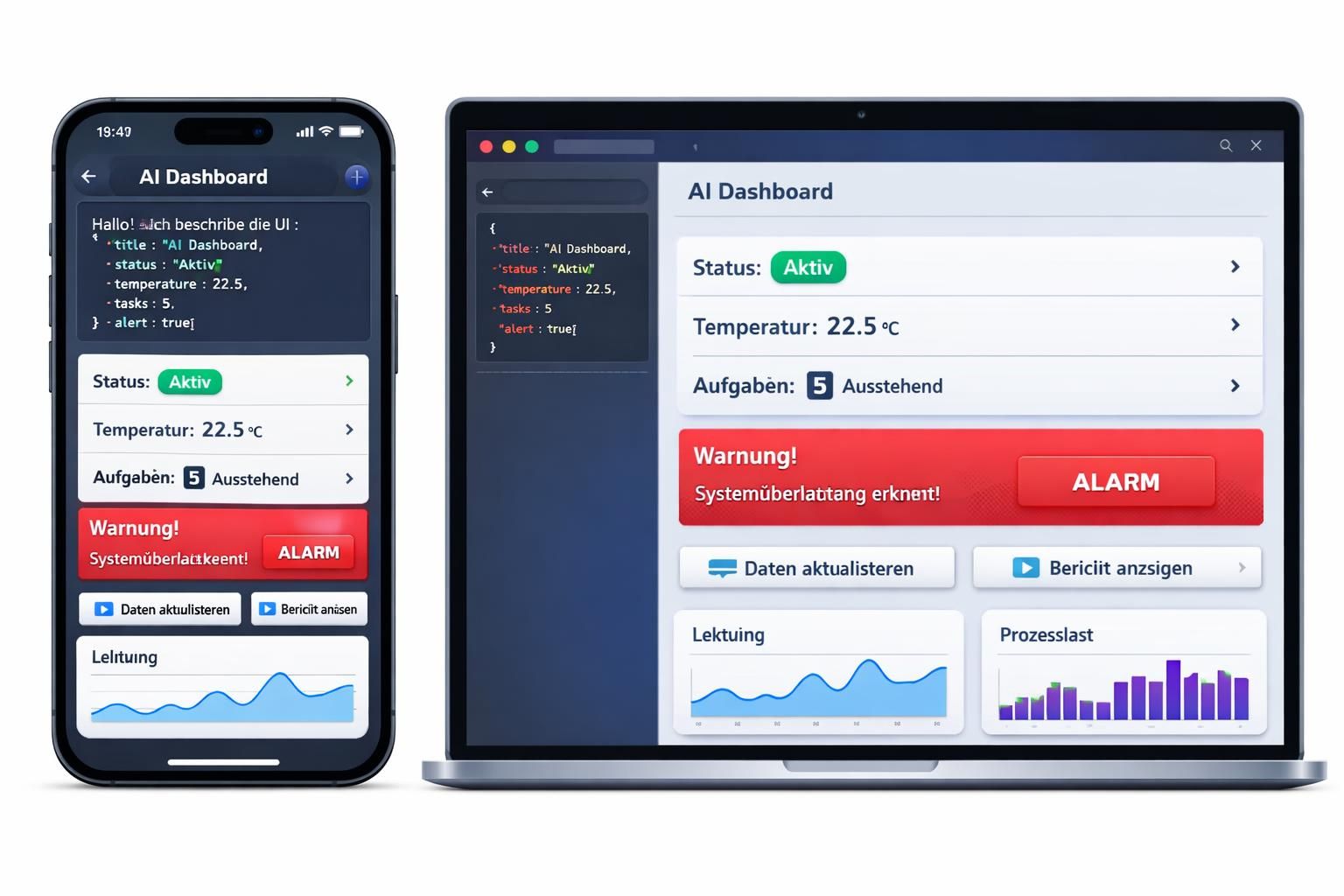

A2UI definiert ein deklaratives, JSON‑basiertes Format, mit dem KI‑Agenten UI‑Strukturen wie Karten, Schaltflächen oder Datumsauswahlen beschreiben können. Die Host‑Anwendung übernimmt diese Beschreibung und bildet sie mit nativen Widgets ab — etwa in Web‑Frameworks oder Flutter‑Apps. Das Verfahren trennt die Generierung der UI‑Absicht vom eigentlichen Rendering und reduziert so das Risiko, dass Agenten ausführbaren Code in die Anwendung einschleusen.

Technische Prinzipien und Sicherheitsgarantien

Im Kern steht die Entscheidung, keine ausführbaren Skripte zu übermitteln, sondern strukturierte Komponentenlisten. Das macht die Schnittstelle sicher und rahmenunabhängig. Agenten können Oberflächen inkrementell streamen, was progressives Rendering ermöglicht und dialoggetriebene Workflows flüssiger gestaltet. Google stellt das Projekt als Open‑Source‑Repository auf GitHub bereit, sodass Entwicklerinnen erste Renderer und Demos prüfen können.

Wie A2UI die Benutzererfahrung und die Softwareentwicklung verändert

Statt reiner Textdialoge können Agenten strukturierte Formulare oder interaktive Komponenten erzeugen. Für Nutzerinnen bedeutet das weniger Lernaufwand beim Wechsel zwischen vielen unterschiedlichen Oberflächen; die Mensch‑Maschine‑Interaktion verlagert sich Richtung natürlicher Sprache und konversationeller Steuerung. Beispiele reichen von dynamischen Reservierungsformularen bis zu Agenten, die Produktkataloge mit nativen Karussells präsentieren.

Praxisbeispiele und Integrationen

Bereits existierende Demos veranschaulichen Restaurantfinder‑Interfaces oder maßgeschneiderte Formulare nach Foto‑Upload, oft in Kombination mit Googles LLMs wie Gemini. Für Entwicklerinnen ist die Integration in Frameworks wie Flutter über SDKs (etwa GenUI‑Integrationen) ein konkreter Einstiegspunkt. Für die Branche bedeutet das: kürzere Time‑to‑Market, aber auch neue Anforderungen an Designkataloge und Komponentenbibliotheken, damit Agenten konsistente Oberflächen erzeugen.

Adoption, Risiken und die Folgen für Automatisierung und Arbeit

Analysen gehen davon aus, dass Unternehmen innerhalb der nächsten 12 bis 18 Monate verstärkt KI‑Agenten in Kundenerlebnisse einbinden werden; innerhalb von drei bis fünf Jahren könnten Agenten einen Großteil dieser Interaktionen übernehmen. Das bringt Chancen für Effizienzgewinne und neue, personalisierte Benutzererfahrung, aber auch Herausforderungen bei Governance, Design‑Konsistenz und technischer Skalierung.

Ökosystem, Regulierung und Arbeitsplatzauswirkungen

Der Erfolg von A2UI hängt von einem breiteren Ökosystem ab: Renderer für React, SwiftUI oder Jetpack Compose, verlässliche Komponenten‑Kataloge und Tools für Entwicklerinnen. Gleichzeitig stellt die mögliche Ersetzung repetitiver Tätigkeiten durch Agenten die Frage nach neuen Qualifikationen in der Zukunft der Arbeit. Unternehmen müssen Automatisierung, Sicherheits‑ und Compliance‑Anforderungen sowie Veränderungen in Produktteams koordinieren.

Kurzfristig bleibt die traditionelle Benutzeroberfläche präsent, langfristig könnte das A2UI‑Modell aber den Übergang zu einer dialogzentrierten Interaktion beschleunigen. Beobachterinnen sollten auf die Weiterentwicklung der A2UI‑Spezifikation, die Verbreitung von Renderer‑Implementierungen und erste Produktionsfälle in 2026 achten — sie werden zeigen, wie tief Technologischer Fortschritt und Automatisierung die Nutzererfahrung und die Arbeitsteilung zwischen Mensch und Maschine verschieben.